搜索引擎爬行过程简介(如何让搜索引擎“看到”你的网站)

![]() 游客

2024-03-20 12:52:01

136

游客

2024-03-20 12:52:01

136

最终呈现给我们符合要求的网页,当我们在搜索引擎上输入关键字、筛选、想要找到相关的网站时,搜索引擎会在数以亿计的网页中搜索。搜索引擎是如何找到这些网页的呢?这就需要了解搜索引擎的爬行过程。

爬虫起航:从种子网站开始

爬虫的起点是一些特定的网站、搜索引擎的爬虫是通过链接跳转的方式在网页间移动的,这些网站叫做种子网站。从种子网站开始,不断向下进行爬取,会按照一定的规则,而爬虫在爬行的时候。

URL去重:避免重复抓取

爬虫还需要对已经抓取过的URL进行去重处理,为了避免重复抓取相同的页面。以便在后续的爬虫抓取中进行比对,这个过程需要使用哈希表等数据结构来存储已经抓取过的URL。

网页抓取:获取页面内容

例如文本、爬虫需要获取页面的HTML内容,并解析页面中包含的各种元素,在进行到具体页面的抓取时,图片、视频等。如HTTP协议、这需要用到一系列技术,HTML解析器等。

分析网页结构:生成索引

并根据词频,会对其中的文本内容进行分析,关键字等因素来生成索引,当爬虫获取到页面内容后。这个过程是搜索引擎为后续检索和排序做准备的关键一步。

处理异步请求:获取更多信息

并获取更多的信息、现在越来越多的网页采用Ajax异步加载技术,爬虫也要能够处理异步请求。这通常需要用到一些JavaScript解析器和模拟浏览器等技术。

处理反爬机制:防止被封禁

爬虫还需要能够处理这些反爬机制,由于有些网站为了防止被恶意爬取而设置了反爬机制。请求头伪装等技术手段,IP封禁,这包括各种验证码。

数据存储:保存抓取结果

需要将获取到的数据进行存储,当爬虫抓取完毕后。同时还需要考虑数据安全和存储容量等问题,这个过程需要使用数据库等技术来实现。

定期更新:保持数据更新

搜索引擎需要保持对各个网站内容的实时监控和更新。以保证其检索结果始终是最新的,每个搜索引擎都有自己的定期更新机制。

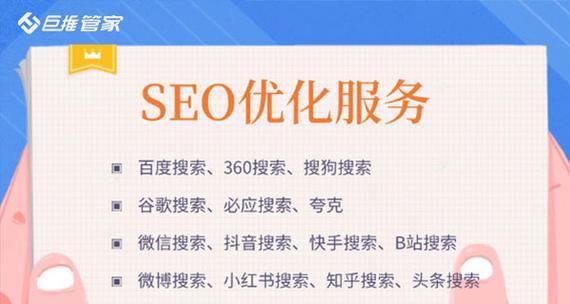

并按照一定的规则来展示检索结果,搜索引擎通过不断地爬行和索引建立自己的数据库。而要让自己的网站被搜索引擎“看到”关键字优化,、我们需要遵循一定的SEO原则、外部链接优化等、包括网站结构优化。才能让搜索引擎更好地收录和展示我们的网站,只有这样。

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 3561739510@qq.com 举报,一经查实,本站将立刻删除。

转载请注明来自365seo,本文标题:《搜索引擎爬行过程简介(如何让搜索引擎“看到”你的网站)》

标签:

- 搜索

- 最新文章

- 热门文章

-

- 百度简单搜索的用户体验如何?它的优势和劣势是什么?

- 推广网站有哪些策略?如何提高转化率?

- 看网站关键词排名优化怎么看

- 为什么网站会被降权?常见原因有哪些?

- 咸宁网站关键词优化多久有排名

- 如何使用seo查询工具进行网站分析?

- 短视频关键词矩阵设置方法是什么?

- 网站的长尾词排名优化用该怎么做?如何提升网站长尾关键词的SEO效果?

- 如何优化网站文章以提升收录率?收录率低的原因是什么?

- 影响seo排名的因素有哪些方面?如何优化提升网站排名?

- 网站里面搜索关键词是什么

- 抖音关键词推广有哪些途径?

- 抖音关键词词包如何添加?提高搜索量的方法是什么?

- 网站SEO优化排名有哪些技巧?如何有效提升网站SEO排名?

- 谷歌怎么看关键词自然排名

- 网站设计的最新趋势是什么?如何优化关键词?

- 广东企业网站建设如何选择?如何提升网站用户体验?

- 淘宝英文关键词排行榜在哪里查看?如何分析关键词热度?

- 抖音搜索不到关键词时应如何解决?

- 网站优化的5个小技巧是什么?如何有效提升网站排名?

- 热门tag

- 标签列表