搜索引擎爬行规则分析(优化网站排名的关键)

![]() 游客

2024-06-02 09:26:02

113

游客

2024-06-02 09:26:02

113

随着互联网的不断发展,搜索引擎已经成为人们获取信息的主要工具。而作为网站管理员,了解搜索引擎的爬行规则对于提高网站排名是至关重要的。本文将从多个方面分析搜索引擎对网站的爬行规则。

爬虫的基本概念

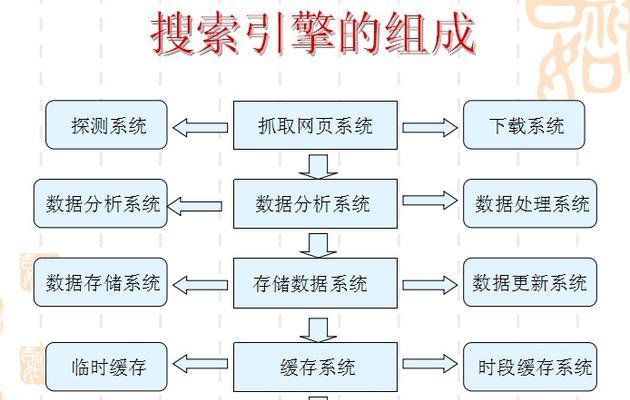

搜索引擎通过程序,利用网络爬虫不断遍历互联网上的网页,将这些网页进行解析并储存为数据。而爬虫就是搜索引擎中的重要工具之一,它具有一定的“智能”,会根据搜索引擎所设定的爬行规则来进行爬行。同时,每个搜索引擎都有自己的爬虫算法和数据权重计算方法。

网页结构对于爬行的影响

搜索引擎在爬行网站时,会根据网页结构进行判断。网页结构是指网页内部HTML标签的组织方式以及内容呈现方式。如果网页结构混乱,存在大量冗余代码或无意义内容,则会导致搜索引擎对于该网站的访问频率减少。

重要性能够提高排名

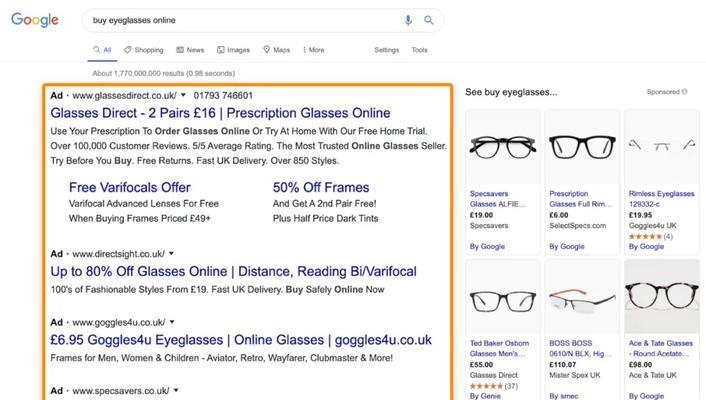

搜索引擎在进行爬行时,会根据网页中的标题、关键字和描述等元素来确定该网页的主题和相关性。在网页中正确使用关键词,并将其放在标题、描述和正文中,能够提高该页面在搜索结果中的排名。

页面质量对于权重的影响

搜索引擎通过对比同类网站页面的质量,来判断该页面在搜索结果中的排名。而页面质量主要取决于页面内容的唯一性、深度以及相关性。在编写网页内容时,应该保证内容有价值且独特。

外部链接与网站排名的关系

外部链接是指其他网站链接至自己网站的链接。而搜索引擎对于外部链接有着很大的重视程度,它们通常被认为是衡量网站相关性和权重的主要因素之一。建立与其他优质网站间相互链接,有助于提高自己网站排名。

重复内容会降低权重

搜索引擎会对于相似的内容进行判断,若存在大量重复内容则会降低权重。而影响权重的程度主要取决于重复内容所占比例和重复内容与原创内容之间的相似度。

新鲜度影响着访问频率

搜索引擎会根据爬虫遍历页面时间来判断该页面是否新鲜。若网站内容更新速度较慢,则会导致访问频率降低,从而影响网站在搜索结果中的排名。

技术优化对于爬行规则的应对

对于搜索引擎爬行规则,我们可以通过技术手段进行应对。在代码中添加sitemap.xml文件和robots.txt文件,通过优化服务器响应速度、压缩图片等方式来提高用户体验和访问速度等。

了解搜索引擎对于网站的爬行规则是提高网站排名的关键之一。从页面结构、页面质量、外部链接、重复内容、新鲜度以及技术优化等方面入手,优化自己网站并符合搜索引擎爬行规则,才能够在搜索结果中获得更好地排名。

版权声明:本文内容由互联网用户自发贡献,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 3561739510@qq.com 举报,一经查实,本站将立刻删除。

转载请注明来自365seo,本文标题:《搜索引擎爬行规则分析(优化网站排名的关键)》

标签:

猜你喜欢

- 搜索

- 最新文章

- 热门文章

-

- 百度简单搜索的用户体验如何?它的优势和劣势是什么?

- 推广网站有哪些策略?如何提高转化率?

- 为什么网站会被降权?常见原因有哪些?

- 看网站关键词排名优化怎么看

- 如何使用seo查询工具进行网站分析?

- 短视频关键词矩阵设置方法是什么?

- 影响seo排名的因素有哪些方面?如何优化提升网站排名?

- 咸宁网站关键词优化多久有排名

- 网站的长尾词排名优化用该怎么做?如何提升网站长尾关键词的SEO效果?

- 如何优化网站文章以提升收录率?收录率低的原因是什么?

- 网站里面搜索关键词是什么

- 抖音关键词推广有哪些途径?

- 抖音关键词词包如何添加?提高搜索量的方法是什么?

- 网站SEO优化排名有哪些技巧?如何有效提升网站SEO排名?

- 网站优化的5个小技巧是什么?如何有效提升网站排名?

- 谷歌怎么看关键词自然排名

- 网站设计的最新趋势是什么?如何优化关键词?

- 广东企业网站建设如何选择?如何提升网站用户体验?

- 淘宝英文关键词排行榜在哪里查看?如何分析关键词热度?

- 抖音搜索不到关键词时应如何解决?

- 热门tag

- 标签列表